Der Aufbau dürfte vertraut sein, sofern man schon einmal Bilder mithilfe künstlicher Intelligenz erstellt hat. Aus einem kurzen Text, der die wichtigsten Elemente des gewünschten Fotos beschreibt, entsteht mit etwas Geduld ein mehr oder weniger zufriedenstellendes Ergebnis.

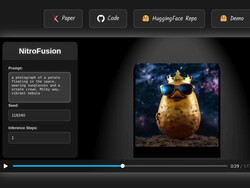

Nur dass dies mit NitroDiffusion, einem an der University of Surrey entwickelten großen Sprachmodell, erheblich schneller geschieht als gewohnt. Eine Demonstration zeigt, dass sich das Bild bereits während der Eingabe verändern, wenn weitere Informationen eingegeben werden.

Grund dafür ist eine enorme Verschlankung des gesamten Prozesses von einer Vielzahl von Iterationen auf einen einzigen Schritt. So gelingt die Erzeugung der Bilder annähernd in Echtzeit, was eine spontane Anpassung der Eingabe oder eine schnelle Erhöhung der Schritte für eine bessere Qualität möglich macht.

Aber nicht nur die Wartezeit ist verkürzt, auch die nötige Rechenleistung fällt so niedrig aus, dass ein Gaming-PC zur Berechnung genügt. Laut Aussagen der Forschenden sollte dieser sich allerdings schon im High-End-Segment einsortieren.

Und dennoch wäre dies ein wichtiger Schritt in Richtung einer offenen Nutzung der Technik, unabhängig von den hochpotenten Serverfarmen einiger weniger Akteure. Dementsprechend findet sich der Code bereits bei GitHub.

Auch eine Demo-Version lässt sich über diese Seite aufrufen, die aktuell allerdings nur online funktioniert. Nach dem Einstellen der Bildgröße kann das Ausprobieren schon beginnen. Weil jedes Mal vier Resultate präsentiert werden, kann man zudem gut beobachten, was fehlende Kontrollschritte bedeuten. Vor allem menschliche Darstellungen lassen sich am ehesten als gruselig beschreiben.

Wobei mindestens eines der Bilder fast immer gut aussieht. Es lohnt sich, das Ganze einmal auszuprobieren. Und eine funktionstüchtige App für PC ist bereits angekündigt.