Apple hat wie erwartet viele Ankündigung in Bezug auf die künstliche Intelligenz getroffen. Diese wurden unter dem Namen Apple Intelligence zusammengefasst und umfassen im Grunde viele Funktionen typischer KI-Assistenten. Dabei sollen Nutzer allerdings von der tiefen Integration der Funktion profitieren. So agiert das Modell über alle Apps und Gerätegrenzen hinweg, dementsprechend sind die Funktionen nicht nur auf Apple-Apps beschränkt.

Besonders beworben wird der Schutz der Privatsphäre. So sollen viele Abfragen dank der doch erheblichen KI-Leistung aktuellerer Apple-SoCs direkt auf dem Gerät durchgeführt werden, damit ist der Kontakt nicht zwangsläufig immer zur Cloud nötig. Wenn dieser Kontakt aufgrund erhöhter Anforderungen etwa an die Rechenleistung nötig ist, sollen nur relevante Daten übertragen werden. Apple gibt an, dass die Daten dann nicht in der Cloud gespeichert und nur für die Anfrage verwendet werden.

Die Funktionen lassen sich dabei grundsätzlich in drei Gruppen einteilen: Text, Bilder und Aktionen. Wenig überraschen soll das neue System so etwa die Zusammenfassung von Texten ebenso wie die Textformulierung und auch das Korrekturlesen beherrschen. Es können Bilder generiert werden, beispielsweise in Chat-Programmen - damit lassen sich etwa passende GIFs erstellen - oder auch sogenannte Genmoji, welche sich mit einer einfachen Texteingabe erhalten lassen und etwa als Sticker nutzbar sind. Die dritte Funktion bezieht sich auf die Nutzung von Apps. Damit lassen sich in Apps verschiedene Funktionen über entsprechende Sprachbefehle auslösen. Diese Integration soll auch Entwicklern offen stehen.

Herausgehoben wird der persönliche Kontext. Eben von der starken Integration soll die Qualität der KI profitieren. Demonstriert wird dies an einer Eingabe der Daten eines Führerscheins. Siri soll dann ein aufgenommenes Bild heraussuchen können - selbst wenn der Nutzer sich daran nicht mehr erinnert. Die Daten des Führerscheins können dann extrahiert und in das Formular eingesetzt werden können. Extrahierbar sind auch Informationen aus E-Mail, die dann um aktuelle Informationen ergänzt werden - so soll Siri etwa bei der Frage nach der Ankunftszeit einer Person die per E-Mail gesendete E-Mail finden und Live-Informationen zum Flugstatus anzeigen können.

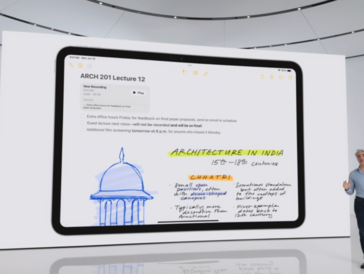

Auch in produktiven Anwendungen sollen sich viele Vorteile ergeben. So lassen sich Telefongespräche aufzeichnen und dann auch transkribieren - dabei werden die Teilnehmer informiert. Sprachaufnahmen können auch gleich in Note als Text ausgegeben werden. Apple gibt zudem an, dass populäre AI-Frameworks wie etwa ChatGPT integriert werden. Siri gibt in einem solchen Fall dann an, dass gerne ChatGPT zurate gezogen würde. Siri fragt in solchen Fällen aber noch einmal nach, ob die Informationen oder etwa auch ein Bild hochgeladen werden dürfte. ChatGPT-Premium soll sich ebenfalls nutzen lassen.

Für Entwickler stehen APIs bereit, so soll sich beispielsweise die Erzeugung von Bildern mit nur wenigen Codezeilen in die eigene App integrieren lassen. Die stärkeren Funktionen von Siri müssen - wenn Siri bereits in die App integriert ist - nicht neu integriert werden. Apple Intelligence wird als kostenfreie Funktion mit den Beta-Versionen von iOS 18, iPadOS 18 und macOS Sequioa im Herbst in der englischen Sprache verfügbar sein, weitere Sprachen sollen im nächsten Jahr folgen.

Quelle(n)

Apple